- 话题

42k 热度

25k 热度

47k 热度

50k 热度

17k 热度

20k 热度

7k 热度

4k 热度

97k 热度

- 10我的Gate时刻

29k 热度

- 置顶

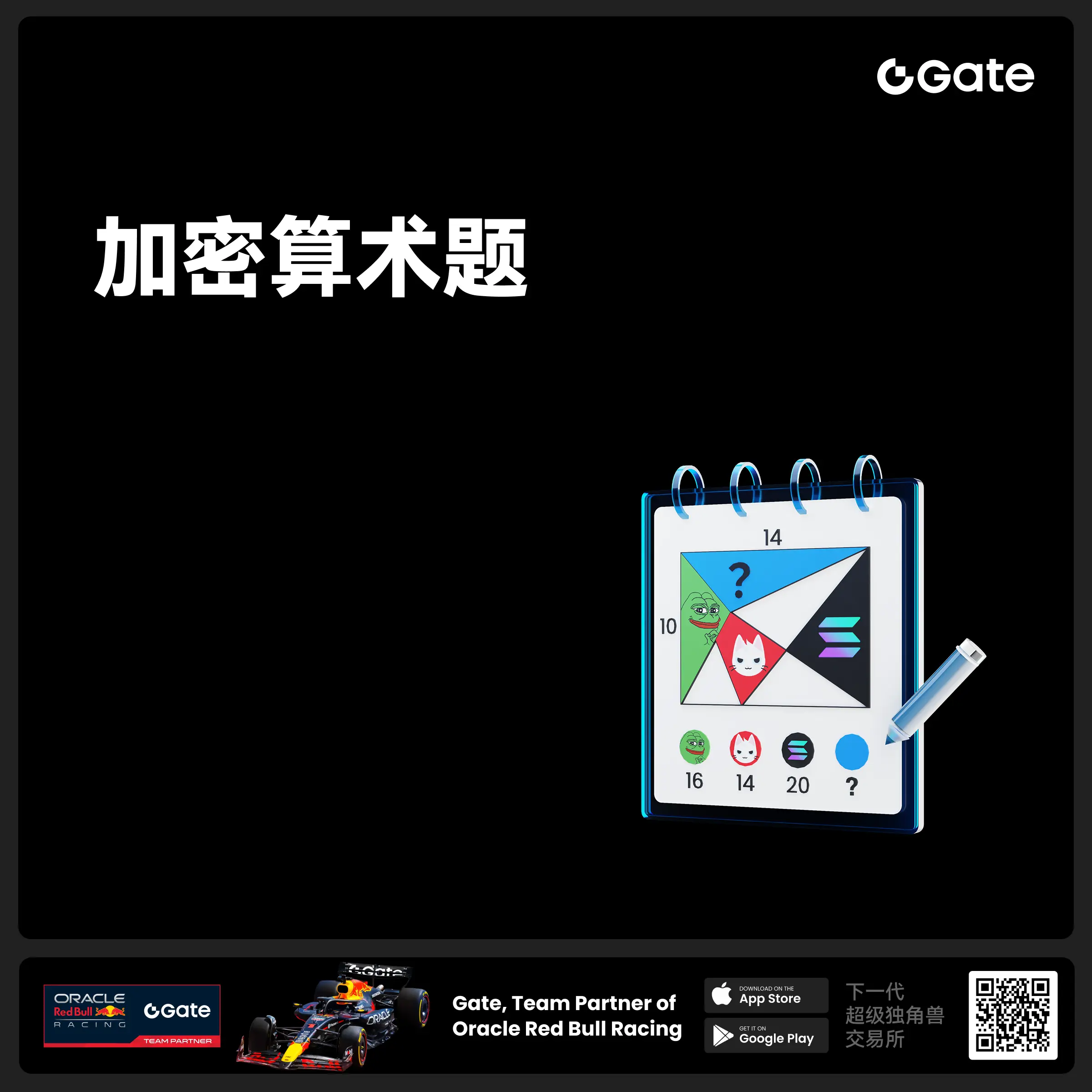

- 🧠 #GateGiveaway# - 加密算术题挑战!

你能解出这道加密题吗?

💰 $10 合约体验券 * 4 位获奖者

参与方式:

1️⃣ 关注 Gate广场_Official

2️⃣ 点赞此条动态贴文

3️⃣ 在评论中留下你的答案

📅 截止时间:7 月 22 日 12:00(UTC+8)

- 📢 ETH冲击4800?我有话说!快来“Gate广场”秀操作,0.1 ETH大奖等你拿!

牛市预言家,可能下一个就是你!想让你的观点成为广场热搜、赢下ETH大奖?现在就是机会!

💰️ 广场5位优质发帖用户+X浏览量前5发帖用户,瓜分0.1 ETH!

🎮 活动怎么玩,0门槛瓜分ETH!

1.话题不服来辩!

带 #ETH冲击4800# 和 #ETH# 在 广场 或 K线ETH下 围绕一下主题展开讨论:

-ETH是否有望突破4800?

-你看好ETH的原因是什么?

-你的ETH持仓策略是?

-ETH能否引领下一轮牛市?

2. X平台同步嗨

在X平台发帖讨论,记得带 #GateSquare# 和 #ETH冲击4800# 标签!

把你X返链接提交以下表单以瓜分大奖:https://www.gate.com/questionnaire/6896

✨发帖要求:

-内容须原创,字数不少于100字,且带活动指定标签

-配图、行情截图、分析看法加分,图文并茂更易精选

-禁止AI写手和灌水刷屏,一旦发现取消奖励资格

-观点鲜明、逻辑清晰,越有料越好!

关注ETH风向,创造观点价值,从广场发帖开始!下一个牛市“预言家”,可能就是你!🦾🏆

⏰ 活动时间:2025年7月18日 16:00 - 2025年7月28日 23:59(UTC+8)

【立即发帖】 展现你的真知灼见,赢取属于你的ETH大奖!

- 🎉 #Gate Alpha 第三届积分狂欢节 & ES Launchpool# 联合推广任务上线!

本次活动总奖池:1,250 枚 ES

任务目标:推广 Eclipse($ES)Launchpool 和 Alpha 第11期 $ES 专场

📄 详情参考:

Launchpool 公告:https://www.gate.com/zh/announcements/article/46134

Alpha 第11期公告:https://www.gate.com/zh/announcements/article/46137

🧩【任务内容】

请围绕 Launchpool 和 Alpha 第11期 活动进行内容创作,并晒出参与截图。

📸【参与方式】

1️⃣ 带上Tag #Gate Alpha 第三届积分狂欢节 & ES Launchpool# 发帖

2️⃣ 晒出以下任一截图:

Launchpool 质押截图(BTC / ETH / ES)

Alpha 交易页面截图(交易 ES)

3️⃣ 发布图文内容,可参考以下方向(≥60字):

简介 ES/Eclipse 项目亮点、代币机制等基本信息

分享你对 ES 项目的观点、前景判断、挖矿体验等

分析 Launchpool 挖矿 或 Alpha 积分玩法的策略和收益对比

🎁【奖励说明】

评选内容质量最优的 10 位 Launchpool/Gate - 和其他领域不一样的是:你想支持一个 Web3 游戏项目,你必须要「双投」——既要投时间,也要投钱。

- 🎉【Gate 3000万纪念】晒出我的Gate时刻,解锁限量好礼!

Gate用户突破3000万!这不仅是数字,更是我们共同的故事。

还记得第一次开通账号的激动,抢购成功的喜悦,或陪伴你的Gate周边吗?

📸 参与 #我的Gate时刻# ,在Gate广场晒出你的故事,一起见证下一个3000万!

✅ 参与方式:

1️⃣ 带话题 #我的Gate时刻# ,发布包含Gate元素的照片或视频

2️⃣ 搭配你的Gate故事、祝福或感言更佳

3️⃣ 分享至Twitter(X)可参与浏览量前10额外奖励

推特回链请填表单:https://www.gate.com/questionnaire/6872

🎁 独家奖励:

🏆 创意大奖(3名):Gate × F1红牛联名赛车模型一辆

👕 共创纪念奖(10名): 国际米兰同款球员卫衣

🥇 参与奖(50名):Gate 品牌抱枕

📣 分享奖(10名):Twitter前10浏览量,送Gate × 国米小夜灯!

*海外用户红牛联名赛车折合为 $200 合约体验券,国米同款球衣折合为 $50 合约体验券,国米小夜灯折合为 $30 合约体验券,品牌抱枕折合为 $20 合约体验券发放

🧠 创意提示:不限元素内容风格,晒图带有如Gate logo、Gate色彩、周边产品、GT图案、活动纪念品、活动现场图等均可参与!

活动截止于7月25日 24:00 UTC+8

3

Mira网络:构建AI信任层 解决偏见与幻觉问题

AI的信任层:Mira网络如何解决AI偏见和幻觉问题

近日,一个名为Mira的网络推出了公共测试版,其目标是为AI构建一个信任层。这引发了人们对AI可信度问题的思考:为什么AI需要被信任?Mira又是如何解决这个问题的?

在讨论AI时,人们往往更关注其强大的能力。然而,AI存在"幻觉"或偏见的问题却常常被忽视。所谓AI的"幻觉",简单来说就是AI有时会"瞎编",一本正经地胡说八道。例如,如果你问AI为什么月亮是粉色的,它可能会给出看似合理但实际上毫无根据的解释。

AI的这些问题与当前的技术路径有关。生成式AI通过预测"最可能"的内容来实现连贯和合理性,但这种方法有时难以验证真伪。此外,训练数据本身可能包含错误、偏见甚至虚构内容,这些都会影响AI的输出。换句话说,AI学习的是人类语言模式,而非事实本身。

目前的概率生成机制和数据驱动模式几乎不可避免地带来了AI幻觉的可能性。虽然在普通知识或娱乐内容中,这种问题暂时不会造成直接后果,但在医疗、法律、航空、金融等高度严谨的领域,却可能产生重大影响。因此,解决AI幻觉和偏见成为了AI演化过程中的核心问题之一。

Mira项目正是致力于解决这一问题。它试图构建AI的信任层,减少AI偏见和幻觉,提升AI的可靠性。那么,Mira是如何实现这一目标的呢?

Mira的核心方法是通过多个AI模型的共识来验证AI输出。Mira本质上是一个验证网络,它利用多个AI模型的共识来验证AI输出的可靠性。更重要的是,它采用了去中心化的共识验证方式。

Mira网络的关键在于去中心化的共识验证。这一方法借鉴了加密领域的优势,同时利用多模型协同的特点,通过集体验证模式来减少偏见和幻觉。

在验证架构方面,Mira协议支持将复杂内容转换为可独立验证的声明。节点运营商参与这些声明的验证,而为了确保节点运营商的诚实性,Mira采用了加密经济激励/惩罚机制。不同AI模型和分散的节点运营商的参与,保证了验证结果的可靠性。

Mira的网络架构包括内容转换、分布式验证和共识机制。内容转换是其中的关键环节。Mira网络首先将候选内容分解成不同的可验证声明,这些声明被分发给节点进行验证,以确定其有效性,并汇总结果达成共识。为保护客户隐私,声明对会以随机分片的方式分发给不同节点,防止信息泄露。

节点运营商负责运行验证器模型,处理声明并提交验证结果。他们参与验证是为了获得收益,这些收益来自为客户创造的价值。Mira网络的目标是降低AI的错误率,特别是在医疗、法律、航空、金融等领域,这可能产生巨大价值。为防止节点运营商投机取巧,持续偏离共识的节点会被惩罚。

总的来说,Mira为实现AI的可靠性提供了一种新思路:在多AI模型基础上构建去中心化共识验证网络,为客户的AI服务带来更高的可靠性,降低AI偏见和幻觉,满足更高准确度和精确率的需求。简而言之,Mira正在构建AI的信任层,这将推动AI应用的深入发展。

目前,用户可以通过Klok(一个基于Mira的LLM聊天应用)参与Mira公共测试网,体验经过验证的AI输出,并有机会赚取Mira积分。这些积分的未来用途尚未公布,但无疑为用户参与提供了额外动力。